Thu thập dữ liệu luôn định hình khả năng hiển thị – nhưng tìm kiếm AI còn quan trọng hơn. Tìm hiểu cách duy trì sự hiện diện mà không mất kiểm soát.

Trong 20 năm, hầu hết các chuyên gia SEO chỉ quan tâm đến Googlebot. Tuy nhiên, trong vài năm trở lại đây, một loạt các trình thu thập thông tin mới đã xuất hiện từ nhiều nền tảng lập chỉ mục khác nhau, chẳng hạn như ChatGPT, Perplexity và các nền tảng khác.

Những trình thu thập thông tin này phục vụ nhiều mục đích khác nhau. Chúng không chỉ là bước đầu tiên hướng tới việc lập chỉ mục. Mà cũng có thể thu thập nội dung để đào tạo mô hình hoặc thực hiện tạo nội dung tăng cường truy xuất (RAG) trên một URL cụ thể theo yêu cầu.

Điều này đặt ra câu hỏi: Bạn có nên cho phép tất cả các bot này thu thập thông tin trên trang web của mình không? Nếu đối tượng của bạn không sử dụng DeepSeek hoặc You.com thì sao? Lợi ích của việc thu thập dữ liệu và mất quyền kiểm soát cách trình bày nội dung là gì?

Không có câu trả lời “đúng” duy nhất, nhưng có một khuôn khổ rõ ràng để tiếp cận câu hỏi này.

Cho phép hầu hết các công cụ AI thu thập thông tin phần lớn nội dung của bạn thường mang lại lợi ích tổng thể. Tuy nhiên, với những tài sản trí tuệ thực sự độc đáo, hãy bảo vệ chúng bằng tường phí hoặc yêu cầu đăng nhập để giữ nguyên giá trị.

Điều đó có nghĩa là với đa số nội dung, bạn nên chủ động tối ưu hóa để AI dễ thu thập – làm phong phú và chia nhỏ nội dung thành từng phần rõ ràng để tăng khả năng hiển thị.

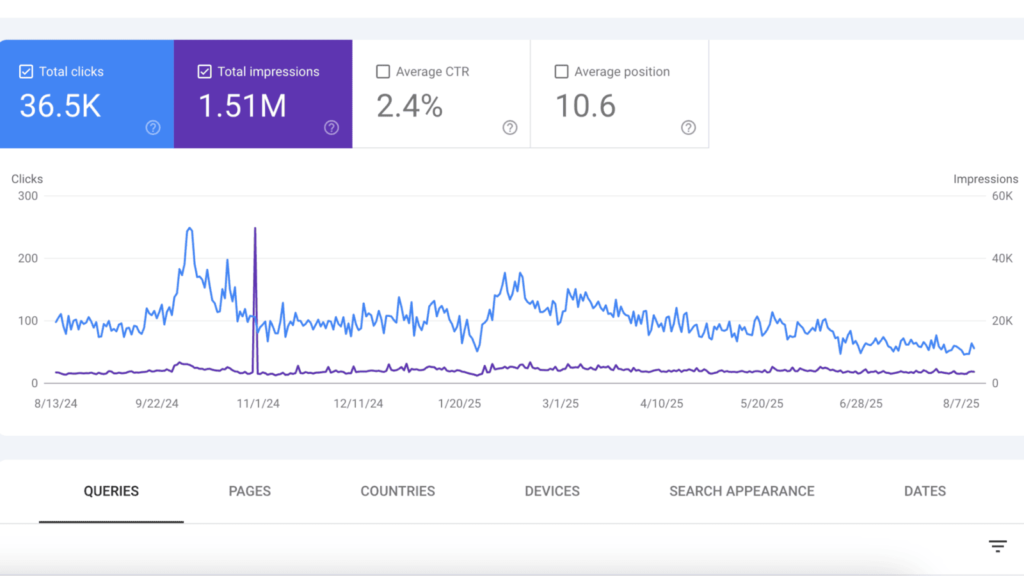

Hãy chuẩn bị tinh thần: Phần lớn website sẽ chứng kiến lưu lượng truy cập giảm trong những năm tới. Nhưng nếu bạn đã lọc lưu lượng truy cập liên quan đến AI trong GA4, có thể bạn sẽ thấy rằng phần lưu lượng còn lại chất lượng hơn nhiều, vì các bề mặt AI phản ánh rất rõ ý định của người dùng.

Phần lớn các website sẽ chứng kiến sự suy giảm của lưu lượng truy cập

Ngoài lưu lượng, bề mặt AI cũng đang trở thành yếu tố quan trọng để xây dựng thương hiệu. Các trích dẫn nổi bật – đặc biệt là vị trí Top 3 trong Chế độ AI hoặc các đoạn văn được liên kết trong ChatGPT – sẽ tác động mạnh mẽ đến nhận thức về thương hiệu.

Đối với nhiều mô hình kinh doanh, tối ưu hóa cho các bề mặt AI chính là con đường mới để gia tăng khả năng hiển thị và độ tin cậy.

Các bề mặt AI ngày càng đóng vai trò là điểm “tiếp xúc đầu tiên” trong hành trình của người dùng, khiến thương hiệu của bạn phải xuất hiện sớm. Chúng cũng ngày càng giống các trang danh mục:

Hiện tại, trong một số trường hợp hiếm hoi (dù tỷ lệ này sẽ tăng nhanh trong tương lai), người dùng vẫn đưa ra quyết định nhờ thương hiệu. Nhưng quan trọng là họ vẫn dựa vào thương hiệu để cảm thấy hài lòng.

Đây không phải là điều mới. Đây là cách Amazon và các nền tảng thương mại điện tử khác đã áp dụng từ nhiều năm nay.

Và cũng giống như những nền tảng đó, với AI mục tiêu không phải là sở hữu mọi điểm tiếp xúc, mà là tạo dựng sự nổi bật thương hiệu: Cung cấp trải nghiệm tuyệt vời và đảm bảo sản phẩm hoặc dịch vụ có chất lượng cao.

Khi làm được điều đó, đến lúc người dùng cần sản phẩm, họ sẽ tìm đến bạn trực tiếp, không cần qua công cụ tìm kiếm AI. Đó là cách bạn giành được thị phần.

Vậy còn những trang web chuyên tổng hợp nội dung từ các nhà cung cấp nhỏ hơn – như cổng thông tin bất động sản, bảng việc làm hay sàn dịch vụ thì sao? Họ có cần lo lắng rằng hệ thống AI sẽ bỏ qua mình hoàn toàn không?

Tôi không nghĩ vậy. Thực tế là ngay cả với những hệ thống quản trị nội dung hiện đại, các doanh nghiệp vừa và nhỏ vẫn gặp khó khăn trong việc duy trì một website cơ bản, chứ chưa nói đến việc phân phối nội dung tối ưu cho các nền tảng AI.

Tôi không thấy khả năng hàng ngàn website nhỏ trong vô số lĩnh vực đều được AI tự động tổng hợp một cách hiệu quả. Đây chính là lý do các nền tảng tổng hợp đáng tin cậy vẫn rất cần thiết.

Họ lọc, kiểm tra và chuẩn hóa dữ liệu. Hệ thống AI vẫn cần những nguồn tổng hợp này.

Các nền tảng tổng hợp cung cấp nhiều hơn danh sách. Ví dụ: dữ liệu đánh giá đã xác minh – sẽ khó bị AI thay thế hơn. Tuy nhiên, các hệ thống AI chắc chắn sẽ tiếp tục ưu tiên các thương hiệu lớn vì họ có độ phủ và mức độ hiển thị cao hơn.

Rủi ro thực sự tồn tại là đối với phương tiện truyền thông kiếm tiền từ lượt xem trang. Lượng truy cập vào nội dung sản phẩm đang giảm mạnh khi các câu trả lời được đưa ra trên bề mặt AI.

Đối với các nhà sáng tạo nội dung bài viết, câu trả lời không phải là chặn hoàn toàn AI. Mà là phải cải tiến

Bởi vì nếu bạn chặn hoàn toàn khả năng thu thập dữ liệu của AI, bạn sẽ mất khả năng hiển thị vào tay đối thủ cạnh tranh. Có một ngoại lệ duy nhất? Đó là nếu bạn có nội dung không thể sao chép, chẳng hạn như:

Trong những trường hợp như vậy, không nhất thiết phải là tất cả hoặc không có gì – hãy cân nhắc việc thu thập dữ liệu một phần. Hãy cho bot nếm thử để nhận được trích dẫn, nhưng đừng để chúng “ăn” hết. Điều này giúp thương hiệu của bạn duy trì tính cạnh tranh trong khi vẫn giữ được lợi thế độc đáo.

Nếu chúng ta đồng ý rằng mục tiêu không chỉ là cho phép AI thu thập thông tin mà còn chủ động khuyến khích nó, thì câu hỏi tiếp theo sẽ là: Làm thế nào để tối ưu hóa nó theo góc độ SEO?

Chỉ tối ưu hóa cho Googlebot thôi là chưa đủ. Bây giờ bạn cần phải phục vụ nhiều trình thu thập thông tin, không phải tất cả đều có cùng mức độ khả năng. Hơn nữa, việc lập chỉ mục không còn ở cấp độ URL nữa.

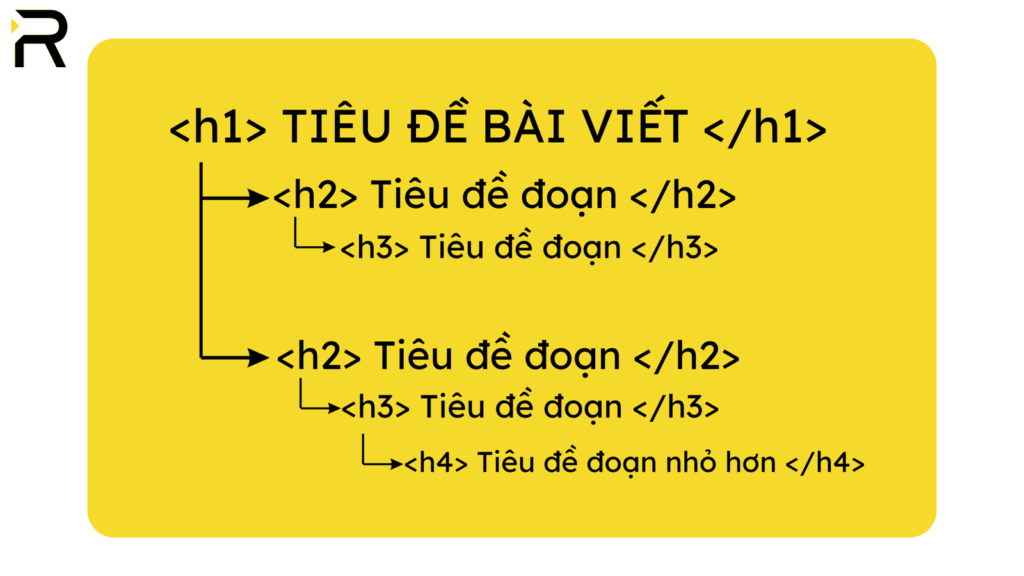

Nội dung được chia thành các thành phần quan trọng và được lưu trữ trong cơ sở dữ liệu vector. Hãy coi mỗi phần nội dung của bạn như một đoạn trích độc lập. Và giành được trích dẫn AI bằng cách:

Các tiêu đề phụ H2, H3 phải được trình bày theo cấu trúc rõ ràng

Nếu trình thu thập thông tin AI không thể truy cập và hiểu được thông tin đó, nó sẽ không trích dẫn thông tin đó.

Mặc dù có nhiều lời đồn thổi, nhưng llms.txt không phải là tiêu chuẩn chính thức, không được áp dụng rộng rãi và không có công cụ lập chỉ mục AI lớn nào tôn trọng nó. Điều này có nghĩa là tệp có thể sẽ không được kiểm tra theo mặc định và do đó nhiều trang web có thể thấy ít hoạt động thu thập thông tin.

Liệu điều đó có thể thay đổi không? Có thể, nhưng cho đến khi nó được thông qua, đừng lãng phí thời gian triển khai một tệp mà bot không kiểm tra. Những cải tiến SEO kỹ thuật khác, chẳng hạn như dữ liệu có cấu trúc dựa trên biểu đồ và cải thiện tốc độ thu thập thông tin, có nhiều khả năng tác động tích cực đến khả năng hiển thị trên bề mặt AI.

Tập trung vào những gì quan trọng đối với khả năng hiển thị của AI hiện tại, chứ không phải vào tương lai giả định khó có thể xảy ra.

Tôi đã đề cập đến việc:

Nhiều chiến thuật tìm kiếm truyền thống này cũng đúng với bot AI:

Những nguyên tắc cơ bản này trở nên quan trọng hơn trong thế giới AI, nơi chúng ta thấy Google đang chủ động dọn dẹp chỉ mục của mình. Tôi cho rằng việc từ chối phần lớn các URL đã được lập chỉ mục trước đó sẽ cải thiện chất lượng nội dung “RAG”.

Tuy nhiên, việc đo lường hoạt động thu thập dữ liệu cần phải vượt ra ngoài phạm vi dữ liệu dễ truy cập như báo cáo số liệu thống kê thu thập dữ liệu trong Google Search Console. Và tập trung nhiều hơn vào các tệp nhật ký , trong đó có báo cáo rõ ràng hơn về tất cả các loại trình thu thập thông tin AI khác nhau.

Các CDN như Cloudflare và trình theo dõi khả năng hiển thị bằng AI đang cung cấp báo cáo, giúp việc này dễ tiếp cận hơn bao giờ hết.

Trong khi các nền tảng Googlebot, Bingbot và AI nhận được nhiều sự chú ý nhất thì các công cụ thu thập thông tin SEO cũng truy cập rất nhiều vào nhiều trang web. Trước khi các hệ thống AI trở nên phổ biến, tôi đã chặn hầu hết chúng thông qua .htaccess. Chúng mang lại ít giá trị đổi lại trong khi lại tiết lộ những thông tin chi tiết về đối thủ cạnh tranh.

Giờ đây, quan điểm của tôi đã thay đổi. Tôi cho phép chúng xuất hiện vì chúng góp phần nâng cao khả năng hiển thị thương hiệu trong nội dung do AI tạo ra.

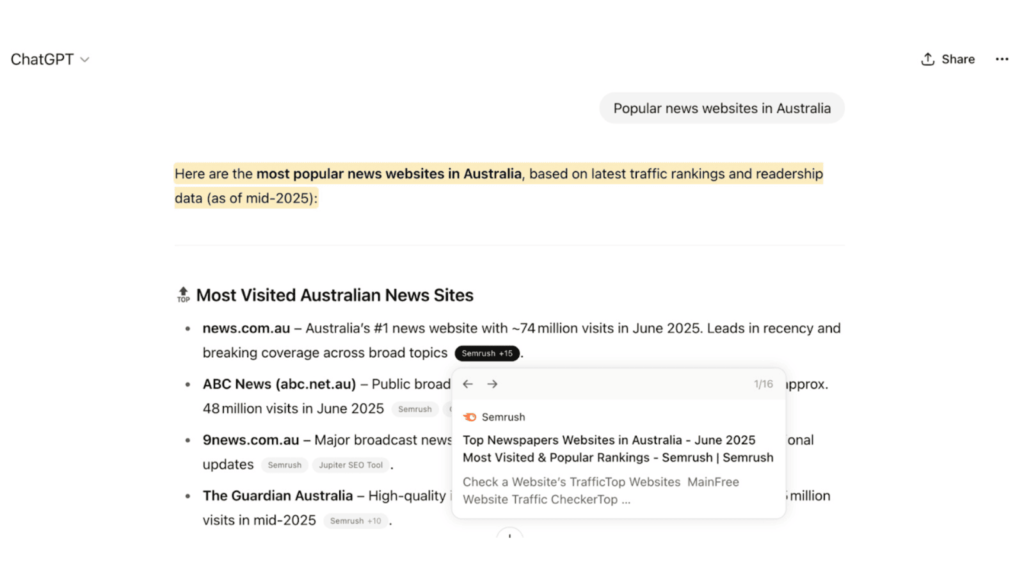

Với tôi, việc khẳng định trang web của mình là phổ biến nhất là một chuyện – nhưng kết quả lại khác khi ChatGPT hoặc Gemini đưa ra, dựa trên dữ liệu lưu lượng truy cập của Semrush.

Kết quả khi ChatGPT/Gemini đưa ra

Hệ thống AI ưu tiên sự đồng thuận. Tín hiệu càng khớp nhau thì khả năng thông điệp của bạn được lặp lại càng cao. Cho phép trình thu thập thông tin SEO xác minh vị trí thị trường của bạn, được giới thiệu trên các trang web so sánh và được liệt kê trong các thư mục đều giúp củng cố câu chuyện của bạn – với điều kiện là bạn đang mang lại giá trị thực sự.

Trong kỷ nguyên AI, vấn đề không phải là xây dựng liên kết mà là quản lý trích dẫn. Hãy tuyển chọn nội dung có thể thu thập thông tin từ bên ngoài, củng cố thương hiệu của bạn bằng các trích dẫn bên ngoài. Điều này làm tăng thêm sức nặng. Nó xây dựng lòng tin. Thu thập dữ liệu không còn chỉ là việc lập chỉ mục trang web nữa. Nó còn là việc quản lý thương hiệu kỹ thuật số.

Vậy nên hãy để bot tự tìm hiểu. Cung cấp cho chúng những thông tin có cấu trúc, hữu ích và chất lượng cao. Khả năng hiển thị tìm kiếm AI không chỉ liên quan đến lưu lượng truy cập. Đó là sự tin cậy, định vị và mức độ nổi bật của thương hiệu.

Sự xuất hiện của bot AI không chỉ là thử thách kỹ thuật, mà là lời nhắc: nội dung không còn tồn tại chỉ để xếp hạng trên Google. Khi AI trở thành cổng thông tin đầu tiên của người dùng, thương hiệu nào kiểm soát tốt các dữ liệu của mình được tiếp cận sẽ nắm lợi thế lớn hơn nhiều so với chỉ tối ưu từ khóa.

Đây không chỉ là câu chuyện SEO nữa, mà là câu chuyện quản trị thương hiệu số. Doanh nghiệp cần xác định rõ phần nào trên website nên mở để AI dễ dàng trích dẫn, phần nào cần giữ lại như tài sản độc quyền. Cách tiếp cận này không chỉ bảo vệ giá trị nội dung mà còn biến AI thành “kênh phân phối tự nhiên” giúp thương hiệu xuất hiện đúng lúc, đúng chỗ, mà không đánh mất quyền kiểm soát.

Nguồn: Search Engine Land

Ready to find your own inspiration for the next project?

Start a project